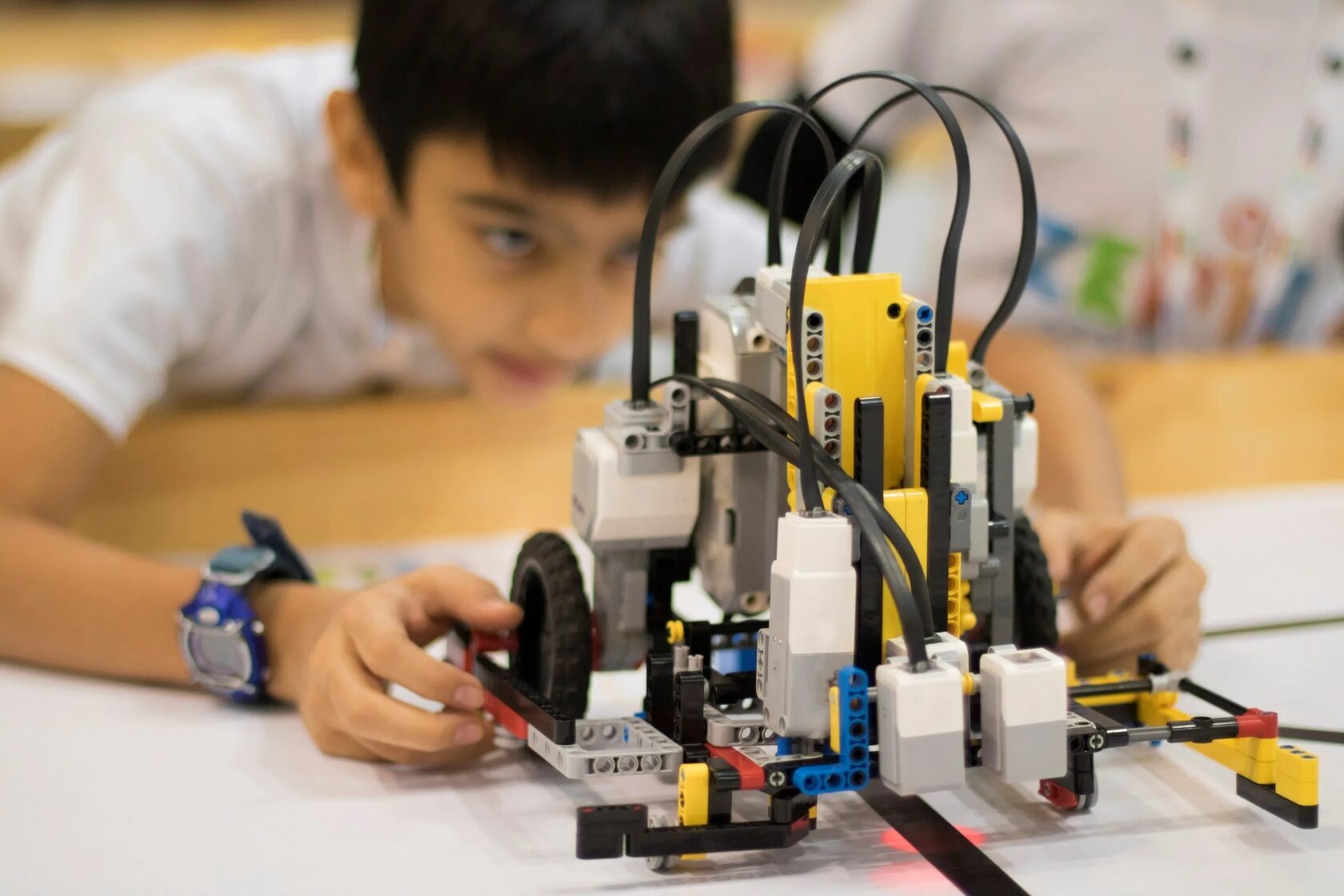

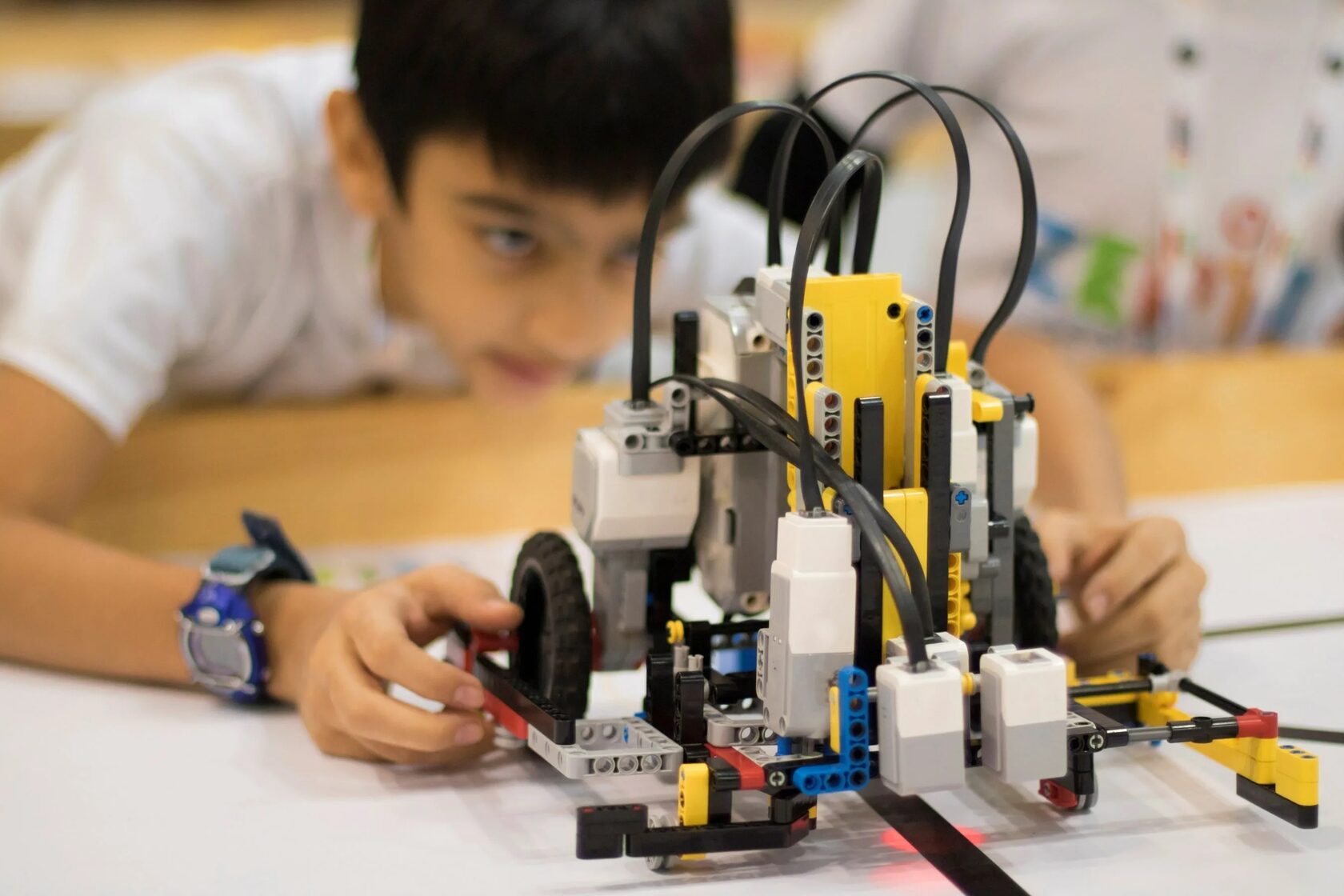

Три закона робототехники Айзека Азимова - это плод вымысла талантливого автора, известного писателя. Эти правила были описаны в художественных произведениях, первым из которых стал рассказ "Хоровод", изданный в 1942 г. Они быстро распространились по мировой научной фантастике, все чаще используются в книгах, фильмах, сериалах и комиксах.

Какие три закона робототехники

Айзек Азимов, придумавший 3 закона роботехники, написал целую серию научно-фантастических произведений. В его книгах люди и роботы жили в соответствии с тремя правилами. После смерти Азимова в 1992 г. его книги превратились в классику жанра, а сам он стал одним из наиболее влиятельных писателей современности. Придуманные им 3 закона до сих пор нередко используются фантастами.

Три закона роботехники, придуманные Айзеком Азимовым, гласят:

- Первый. Робот не может причинять вред человеку. Если его бездействие приведет к опасным, нежелательным для людей последствиям, то он также не может ничего не предпринимать. Благодаря этому правилу, роботы не могут вмешиваться в дела людей, в которых их участие могло бы навредить. Кроме того, принцип обеспечивает безопасность человечества. Исходя из этого закона роботехники, роботов программируют так, чтобы исключать опасность для людей.

- Второй. Робот обязан подчиняться указаниям человека. Исключениями становятся ситуации, противоречащие первому правилу. То есть любой приказ, если только он не противоречит 1-ому принципу, механизм должен выполнять, подчиняясь людям. Это гарантия того, что люди не утратят контроль над роботами. А значит, и потенциальная опасность, исходящая со стороны сложной техники, является практически нулевой.

- Третий. Робот должен защищать свою безопасность. Этому закону машина следует лишь в ситуациях, когда ее действия не будут противоречить первым 2 правилам. То есть робототехника оснащается механизмами для самозащиты, благодаря чему удается сохранять ее работоспособность.

Эти три закона в сочетании обеспечивают максимально полезное взаимодействие между техникой и человеком. При этом риски сводятся к минимуму. В современном мире этот фантастический набор правил получает новую актуальность. Поскольку роботехника вошла в человеческую жизнь, вероятно, продолжит и дальше развиваться и совершенствоваться, становится важно создавать ее так, чтобы не подвергнуть людей опасности.

Некоторые специалисты утверждают, что в современном мире дополнительно к уже существующим принципам Айзека Азимова нужно придумывать новые. В частности, профессор Бруклинского юридического института Френк Паскуале предлагает добавить еще 4. Он приводит следующие принципы:

- Роботехника должна дополнять специалистов-людей, но не превращаться в замену профессионалам.

- ИИ не должен подделывать человека.

- Нужно предотвратить усиление гонок вооружения с нулевой суммой в сфере искусственного интеллекта.

- Роботы, системы ИИ должны указывать на личность создателя или владельца, контролирующего их деятельность человека.

Законы, предложенные Айзеком Азимовым, не случайно идут в указанном порядке. Автор сразу расставил приоритеты, выделил, что важнее. Только в такой последовательности можно получить мир, безопасный и приятный для жизни.

Если робот будет защищать сначала себя, то запросто может причинить вред человеку или допустить, чтобы люди пострадали в опасной ситуации. В ситуациях, когда на первом месте выполнение приказов, итогом станет кровопролитная война: главы враждующих государств могут использовать подчиняющихся им роботов для устранения целых стран.

Кроме того, роботы в таких ситуациях были бы непослушными, а значит, зачастую бесполезными. Взаимодействие с ними вызывало бы дискомфорт, требовало дипломатических навыков или хитрости.

Кроме трех законов позднее был добавлен еще 1, нулевой. Согласно ему, если робот сможет доказать, что его действия в конечном итоге принесут человечеству пользу, то сможет причинить вред человеку. Например, машина может уничтожить злоумышленника, желавшего устроить катастрофу, пострадать от которой могли многие люди или даже вся планета.